人工智能AI(Artificial Intelligence)功能日新月異,應用日漸普及,不少企業相繼採用AI技術,希望做到開源節流、提升生產力。然而,AI帶來的個人私隱風險亦不容忽視。

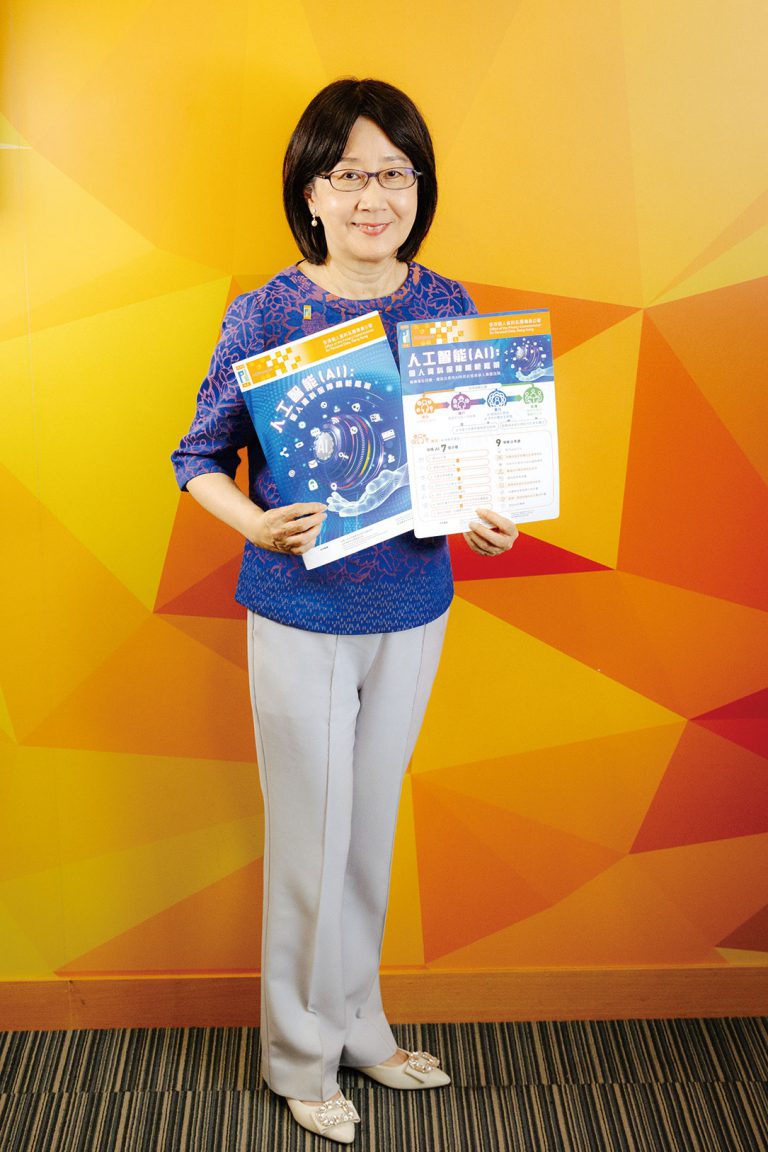

有見及此,個人資料私隱專員公署今年6月發布《人工智能(AI):個人資料保障模範框架》(《模範框架》),協助各大機構在採購、實施及使用AI時,遵從《私隱條例》的規定。

個人資料私隱專員鍾麗玲接受《堅雜誌》專訪時,坦承AI科技會帶來很多好處,但同時也帶來很多私隱風險,強調AI是一把「雙刃劍」,特別是資料外洩事故發生後,所帶來的後果可以非常嚴重。鍾麗玲提醒市民要時刻保持戒心,不要隨便向外界透露個人資料。

鍾麗玲出任私隱專員4年,2020年9月甫上任即面對大規模「起底」活動。檢討現時香港保護私隱現狀,她認為《私隱條例》仍有修改空間,例如引入強制性資料外洩事故通報以及行政罰款等機制,另外還可以加強相關罰則,提高阻嚇力。

文:Mike 圖:黃冠華、網上圖片

關於人工智能引申出來的私隱問題,鍾麗玲強調私隱專員公署很早已經留意到。早於2021年8月,該署出版了《開發及使用人工智能道德標準指引》,主要為開發及使用AI系統時涉及使用個人資料的機構提供建議。今年6月11日,公署再制定出《模範框架》,確保機構在運用AI之餘亦顧及個人資料私隱的保障。

人工智能是「雙刃劍」

鍾麗玲明白到人工智能會為很多行業帶來好處。例如銀行業,人工智能可以用來進行風險評估或審核;又例如會計行業,可以用人工智能來分析財務報表。但另一方面,人工智能也帶來很多私隱和道德風險,她形容這是一把「雙刃劍」。

問到資料外洩的後果可以有多嚴重?鍾麗玲解釋現實中已經有發生過類似情況,如果是大型資料外洩事故,受影響的人數會相當多。至於風險有多大,則要視乎外洩資料的性質,例如聊天機械人洩露用家身份證號碼、護照號碼或電話號碼等等,會造成身份被盜用,甚至用來開設銀行戶口作非法用途。

AI深度偽造技術成詐騙新招

鍾麗玲透露,今年1月和5月發生過兩宗利用深度偽造AI技術的騙案,涉事的是一些國際公司,被騙徒利用相關技術,假扮該公司海外高級人員,例如財務管理人員進行視像會議,其中一間涉事公司損失約2億港元,另一間則損失約400萬港元。

「這些都是一些很實在的個案,AI深度偽造技術越來越成熟,大家真的要小心,不要隨便提供自己的面容、聲音、指模等資料予AI系統。」

AI外洩資料國際並不罕見

香港以外,國際間亦發生過一些有關人工智能外洩個人資料的例子。鍾麗玲提到去年3月,一個很出名的聊天機械人AI模型,發生了較大規模的資料外洩事故,用戶可以隨意閱覽其他使用者的姓名、電郵,甚至信用卡最尾四個數字。這次事件當時也被廣泛報道:「最後該聊天機械人需要『停機』數日,直到修補好有關漏洞後才可以使用。」

去年南韓有一間知名科技公司的員工,把公司機密資料,甚至是一些原代碼都提供給AI系統,繼而製造了另一宗資料外洩事故。鍾麗玲強調:「這些都是已經發生了的真實個案,所以我會擔心風險隨時都有可能發生。」

市民時刻要有一顆「警戒心」

人工智能雖然隱藏了很多「陷阱」,但只要懂得避開,也可以安心使用。鍾麗玲特別提到,很多市民跟聊天機械人對話時,不知不覺就將自己的個人資料發送給對方,這些資料會儲存在資料庫,經演算法推算後,隨時有可能提供給第三者:「譬如你問它『我是誰』?當它答錯時,你就告訴它自己是誰、在哪裏讀書、在哪裏工作,然後這些資料就有很大機會傳給第三者。」

她語重心長地提醒市民,時刻要有一顆「警戒心」,盡量不要提供這麼多個人資料,就算真的需要輸入,也只提供必要的個人資料,還要留意AI系統會將這些資料用來做甚麼。

管理AI系統先做風險評估

《模範框架》中提到,機構在採購、使用及管理AI系統時,需要進行全面的風險評估,有系統地識別、分析及評估過程中涉及的風險,當中包括私隱風險。鍾麗玲形容風險評估相當重要,甚至放眼全球,很多司法管轄區的指引也提出要做好風險評估。

她進一步解釋時舉例,當機構採購AI系統時,需要進行私隱、道德等風險評估,然後再決定採取甚麼措施減低風險。如果AI系統相當簡單,純粹提供一些公司內部資訊予客戶,風險會比較低,就不需要太多人為監督,可稱之為「人在環外」。

相反,一些風險很高的AI系統,例如用來做醫學評估,甚至要分析一些諸如X光片等醫學數據,風險就可大可小。鍾麗玲舉例,AI系統分析X光片時,將沒有肺癆的病人看成有,對病人影響相當深遠,這時候她會建議「人在環中」,即每一個步驟都要有人為監督:「所以說,這種風險為本的評估方式,非常重要。」

處理資料外洩不能心存僥倖

假如真的發生資料外洩事故要怎樣處理?鍾麗玲表示第一時間需要了解問題出在哪裏,繼而採取補救措施,例如立即將相關AI系統和其他系統隔離。另外,機構不論內部或外部,均要有通報機制,除了資料當事人外,也要通知私隱專員公署,讓當局可以幫助當事人,遏止事故的影響和傷害。

鍾麗玲又提到,資料外洩事故發生後,相關機構找上私隱專員公署時往往會顯得驚慌失措,不知道該怎樣做。這時候公署會在技術層面幫助受影響機構,最簡單是建議他們更改密碼。

她強調,機構要第一時間通知受影響客戶,不能心存僥倖,以為只要默不作聲便不會被發現:「這樣做很不智,現時資訊這麼發達,只要有一個客戶知道,在互聯網上一說,全世界都會知道。」如果選擇不通報,說不定會得不償失,令商譽受到極大損傷。

港私隱法例落後於國際

問到現時香港的私隱法例,是否都能與國際接軌?鍾麗玲認為,現時香港法例中有6項保障資料原則,這6項原則規管了整個處理資料流程,當中反映了一些國際標準,不過她承認仍有不足:「你說香港是不是有落後?這個我不得不承認是有落後的。」

鍾麗玲舉例,國際間發生資料外洩事故,往往需要強制性通報,但香港現時並沒有相關措施:「所以我們現在會審視條例,希望跟國際私隱保障接軌。」

至於跟國際聯繫方面,鍾麗玲透露一直都有做,當中有環球性也有地區性。環球性方面,有環球私隱議會;地區性則有亞太區私隱機構:「我們甚至是環球私隱議會國際執法合作工作小組聯席主席,也是人工智能道德與數據保障工作小組成員。」

《私隱條例》有修訂空間

鍾麗玲認為香港的而且確是有空間再修訂《私隱條例》,除了引入強制性資料外洩事故通報機制,更需要直接監管資料處理者。公署也希望加大罰則,例如引入行政罰款機制,按資料外洩事故性質釐訂罰款金額,從而加強阻嚇力。

「《私隱條例》已經很久,當中的罰款也是28年沒有改過,我覺得是時候去加大罰則。這些我們一直在審視,有具體建議後會徵詢政府意見。」她希望政府積極考慮公署的具體建議,同意修訂《私隱條例》,做到與時並進。

打擊起底活動成效卓越

出任個人資料私隱專員至今快將4年,鍾麗玲形容上任前和上任後變化很大。最令她印象深刻的是上任初期的大規模「起底」事件,導致2021年特首五大新猷之一,就是要修改《私隱條例》,引入「起底」行為刑事化,大力打擊「起底」活動。

數據顯示,自《2021年個人資料(私隱)(修訂)條例》生效以來,直至2023年12月31日,私隱專員公署共處理了2,884宗「起底」個案,並就254宗個案展開刑事調查。期間,公署合共進行了42次拘捕行動,共43人被捕;亦向警方轉介共63宗「起底」相關個案作進一步調查。

經過公署近幾年的努力,今時今日網上「起底」活動大幅減少超過八成。這是鍾麗玲上任前後的最大分別,令她相當滿意,形容這是一個「很好的成績」。

問到任內的工作表現會給自己多少分數?鍾麗玲笑說不應由自己評價,要交由市民決定。

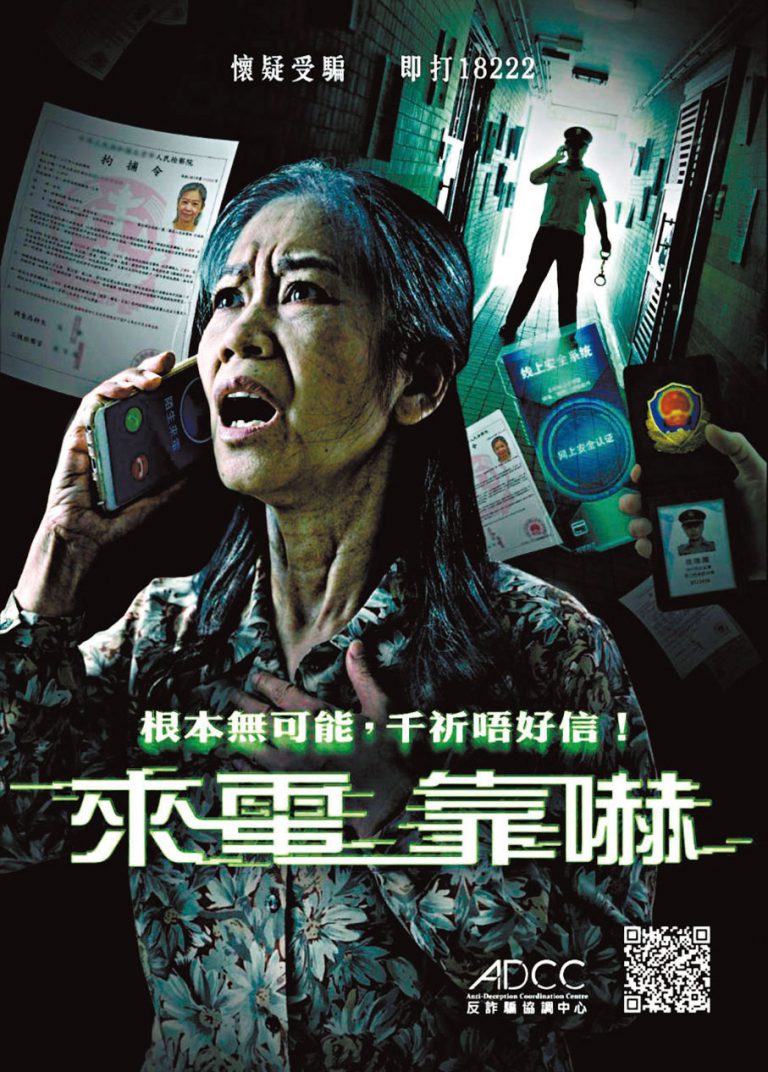

加強宣傳教育工作防詐騙

近年資訊科技發展一日千里,人工智能的冒起更令私隱公署工作量大增,帶來巨大挑戰。

鍾麗玲認為在大環境不斷改變下,未來半年要做多些宣傳教育工作,明年初考慮做一個有關機構使用人工智能系統的審查,另一方亦會加強推廣數據安全的工作:「我覺得不是每次都要發生了事故才去補救,或者出事後才告訴他們該怎麼做,應該要主動提高他們的安全意識。」

現時本港出現很多詐騙案,騙徒往往知道很多「目標獵物」的個人資料。鍾麗玲相信騙徒手上的資料有機會是源於資料外洩,可能是社交媒體或一些大機構洩露,騙徒經「暗網」取得相關資料,因此騙徒其實早已知道受害人的名字,再利用深度偽做技術,上載影片到社交媒體假扮「目標獵物」家人進行詐騙,令人防不勝防。因此,她希望可以多做一些宣傳教育工作,提高市民保護個人資料的意識。